上文我们简单介绍了国产之光——DeepSeek-R1

本文我们来详细介绍如何在本地部署

首先我们进入Ollama官网点击下载:https://ollama.com/

由于我本地是Windows,所以在这儿点击下载Windows

下载结束后,点击安装

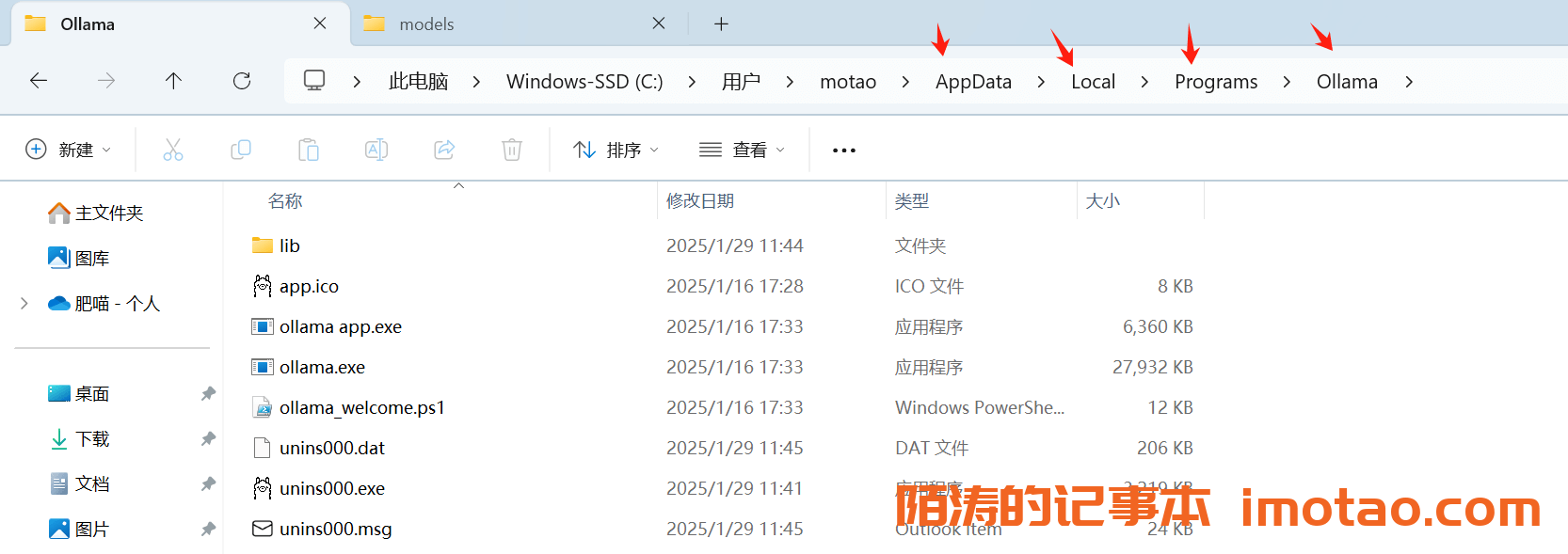

双击安装文件,点击「Install」开始安装。目前的Ollama会默认安装到C盘,路径如下:C:\Users%username%\AppData\Local\Programs\Ollama,并不会让用户自定义选择安装路径。

安装完成后,会在电脑右下角出现Ollama图标,可以不用先启动Ollama,先退出做一些必要路径的配置!

右键图标,会出现退出的按钮「Quit Ollama」,注意:一定要退出Ollama,否则下边的环境配置无法生效!

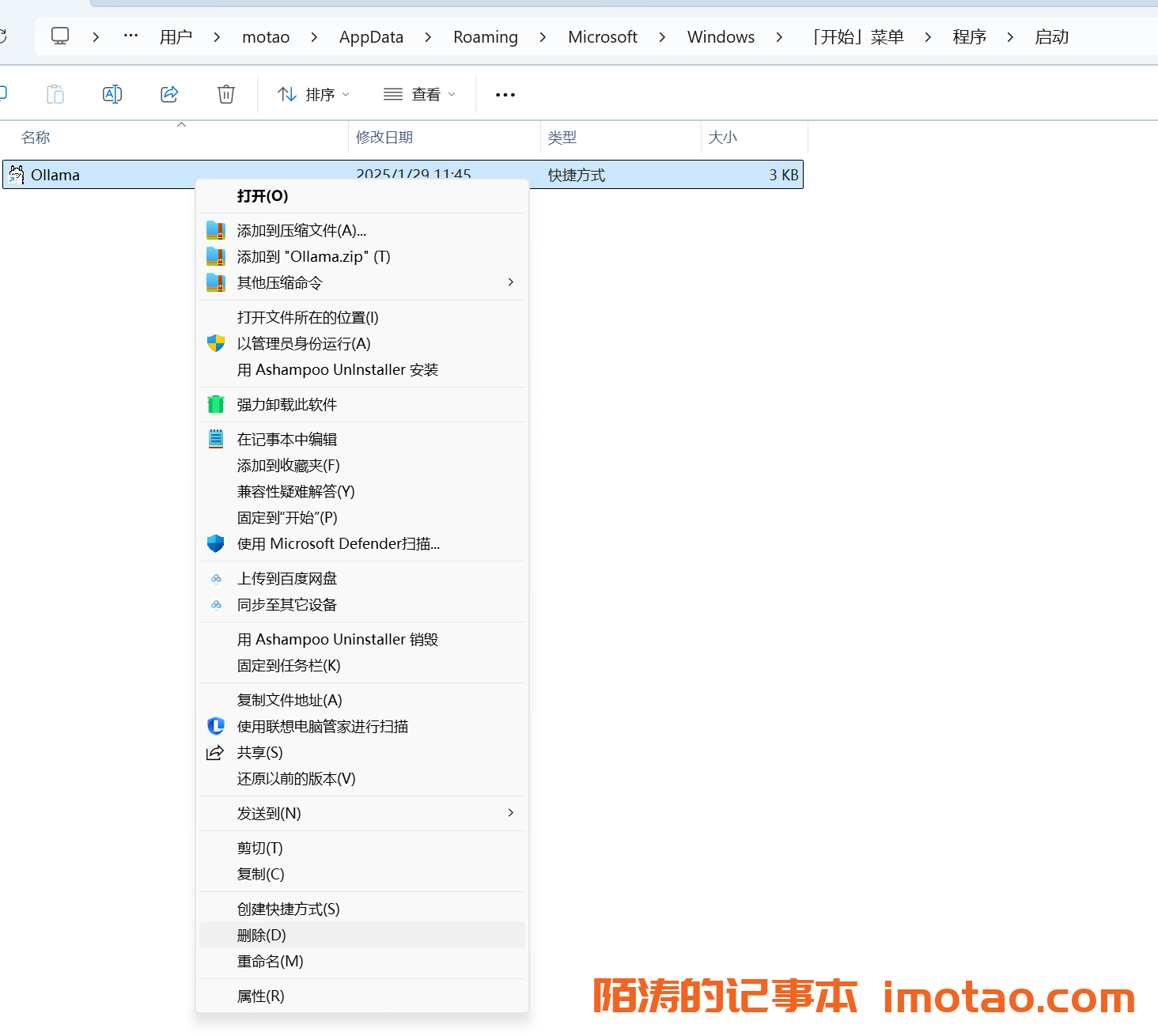

关闭开机自启动(可选)

Ollama 默认会随 Windows 自动启动,可以在「文件资源管理器」的地址栏中访问以下路径,删除其中的Ollama.lnk快捷方式文件,阻止它自动启动。

%APPDATA%\Microsoft\Windows\Start Menu\Programs\Startup

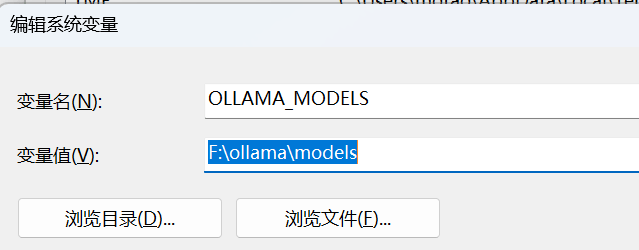

配置环境变量(必须)

Ollama 的默认模型存储路径如下:C:\Users%username%.ollama\models,无论 C 盘空间大小,需要安装多少模型,都建议换一个存放路径到其它盘,否则会影响电脑运行速度。

打开「系统环境变量」,新建一个系统变量OLLAMA_MODELS ,然后设置ollama模型的存储路径。

变量名:OLLAMA_MODELS

变量值(路径):F:\ollama\models

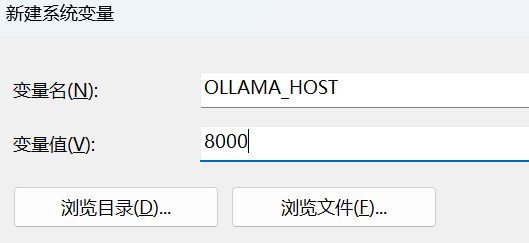

配置端口(可选)

Ollama API 的默认访问地址和侦听端口是http://localhost:11434,只能在装有 Ollama 的系统中直接调用。如果要在网络中提供服务,请修改 API 的侦听地址和端口(在系统环境变量里设置):

变量名:OLLAMA_HOST

变量值(端口)::8000

只填写端口号可以同时侦听(所有) IPv4 和 IPv6 的:8000 端口。(变量值的端口前号前有个冒号:)

注:要使用 IPv6,需要 Ollama 0.0.20 或更高版本。另外,可能需要在 Windows 防火墙中开放相应端口的远程访问。

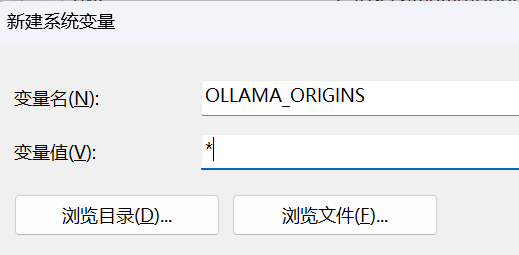

允许浏览器跨域请求(可选)

Ollama 默认只允许来自127.0.0.1和0.0.0.0的跨域请求,如果你计划在其它前端面板中调用 Ollama API,比如Open WebUI,建议放开跨域限制:

变量名:OLLAMA_ORIGINS

变量值:*

运行Ollama

将上述更改的环境变量保存后,在「开始」菜单中找到并重新启动 Ollama。找到ollama.exe的所在位置,在该位置打开cmd

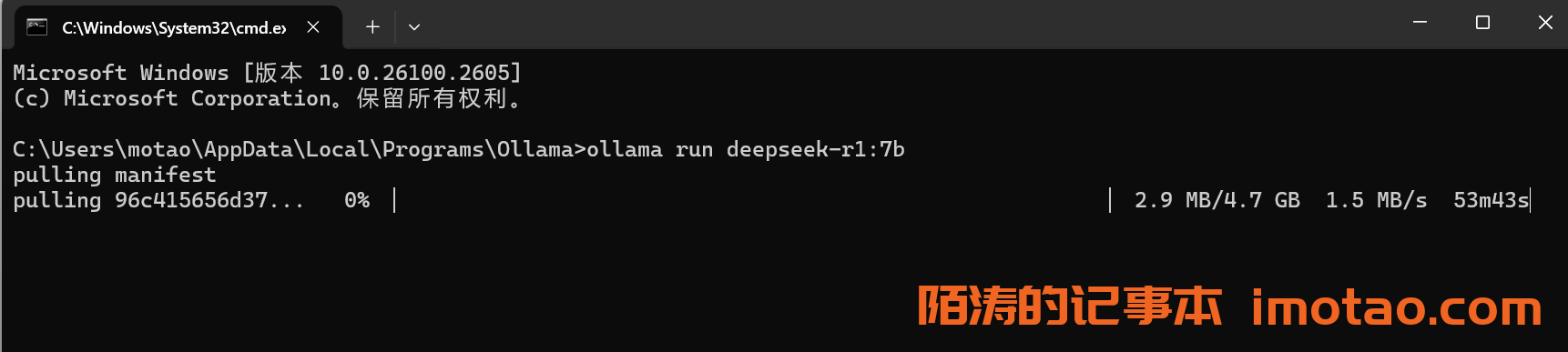

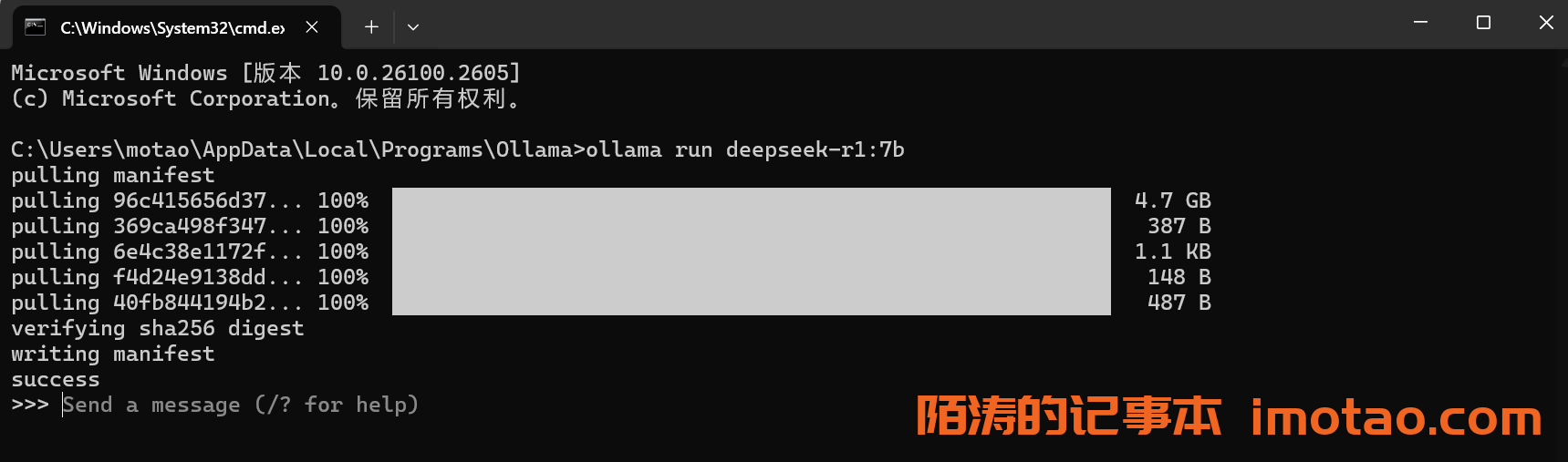

因为笔记本是4060,8G,所以选的是ollama run deepseek-r1:7b

安装完成

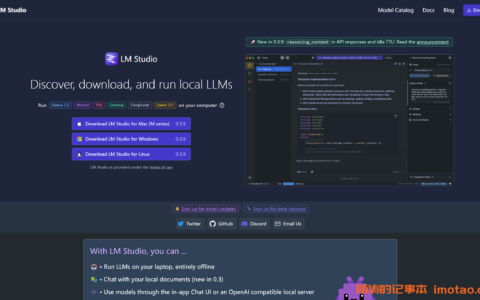

好的,我们现在已经将Ollama安装完毕,接下来该安装浏览器插件——Page Assist – 本地 AI 模型的 Web UI

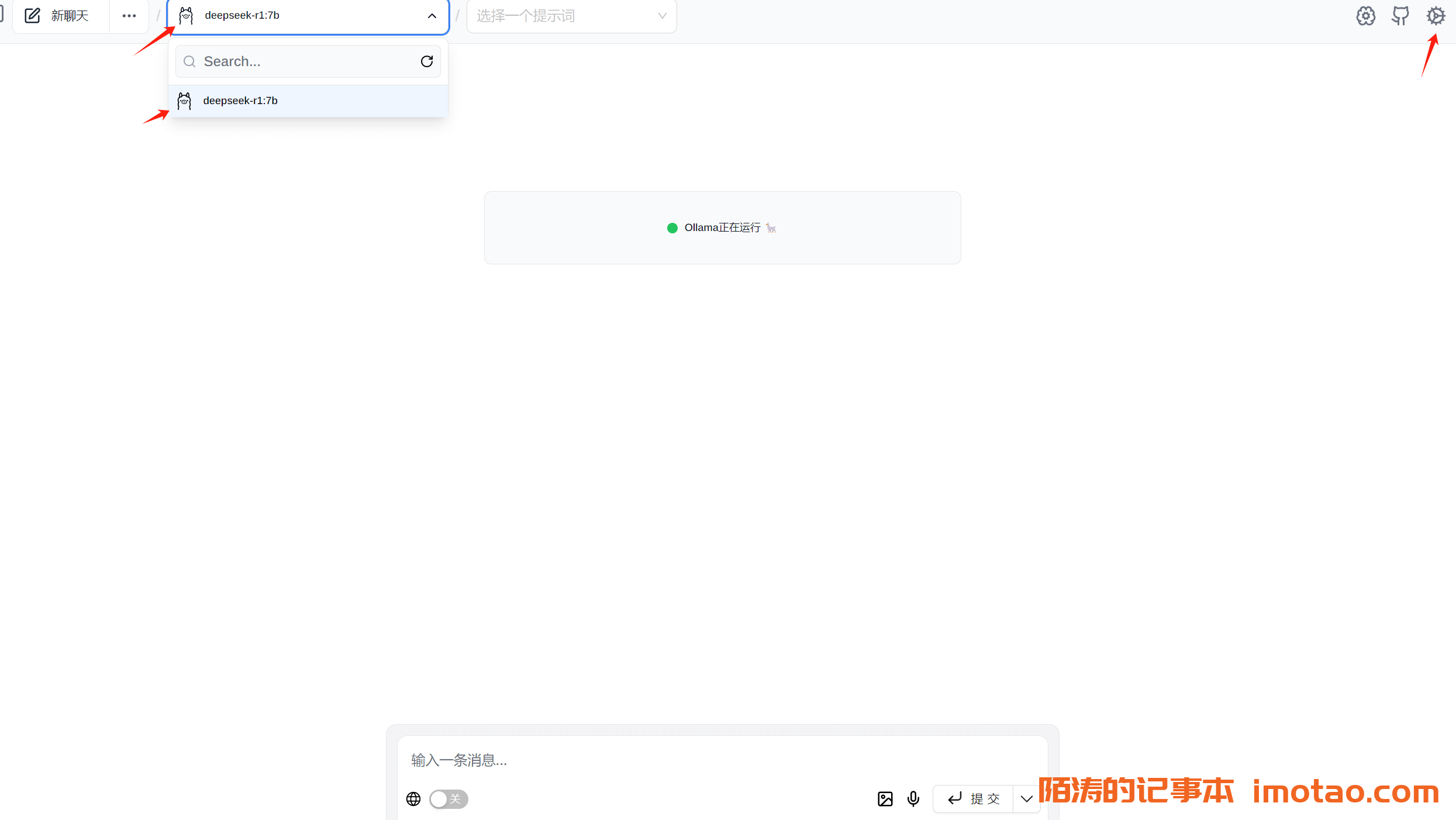

点击后,会弹出一个网页,我们点击左上角,选择刚刚安装好的,再点右上角的设置

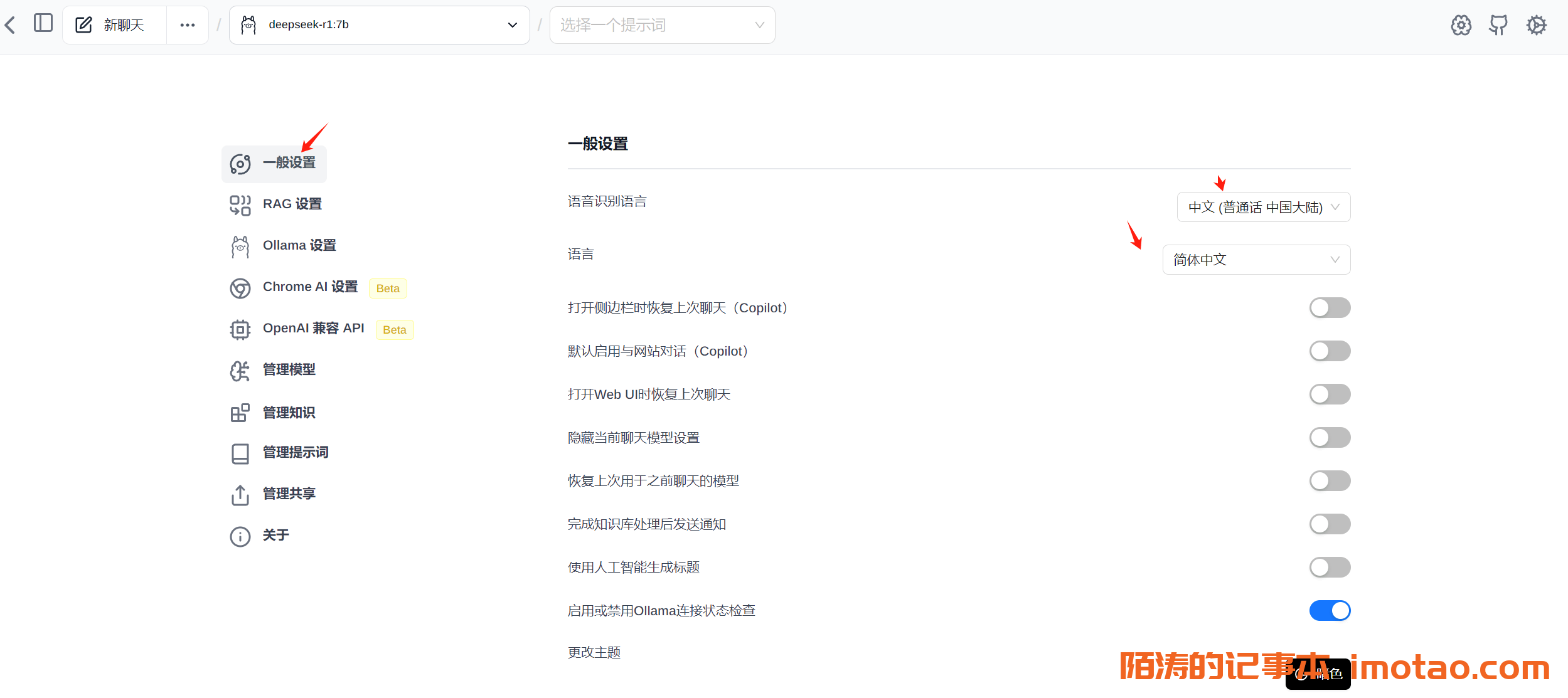

中文在这里设置

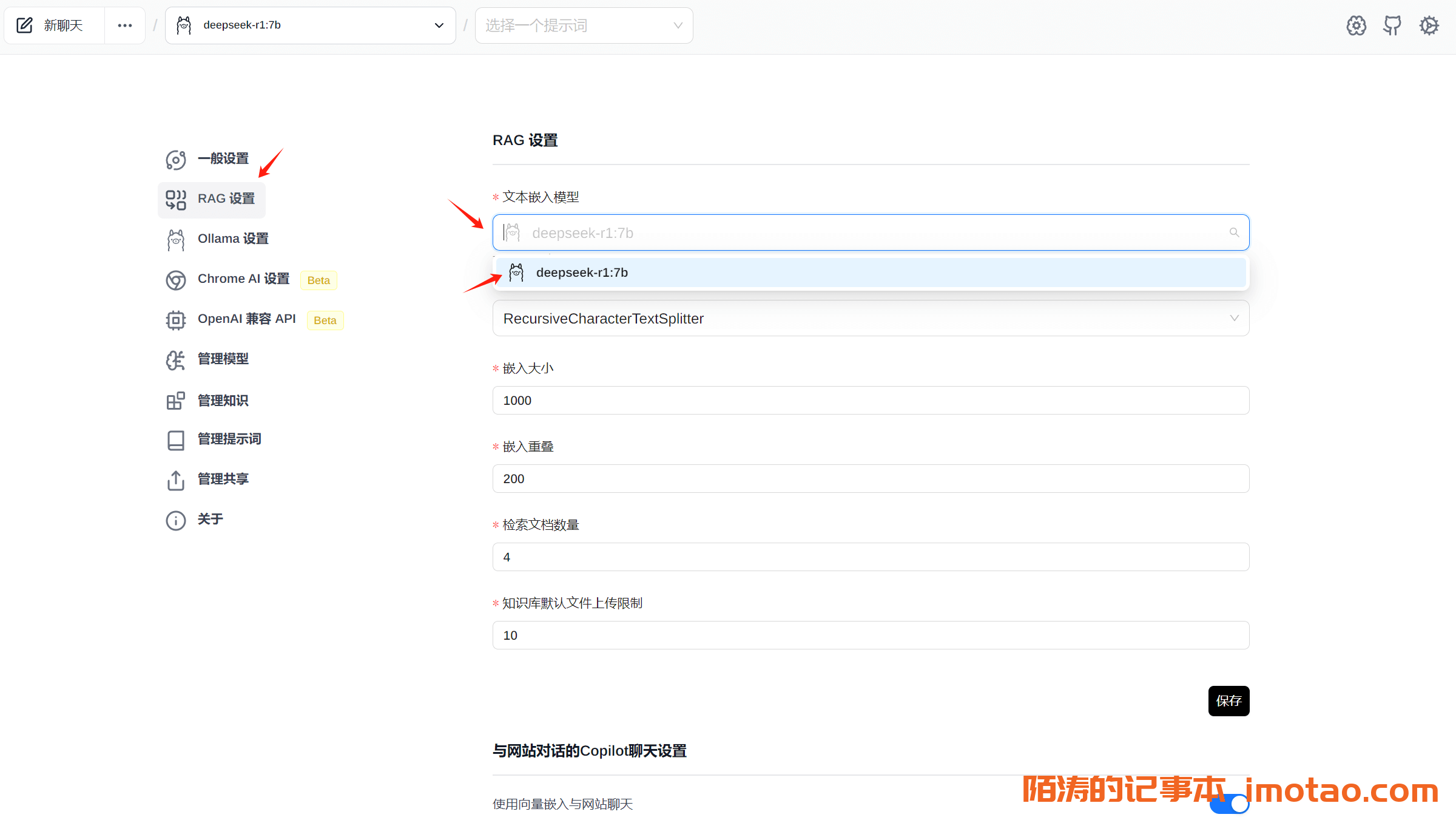

点击RAG,选择刚刚安装的模型

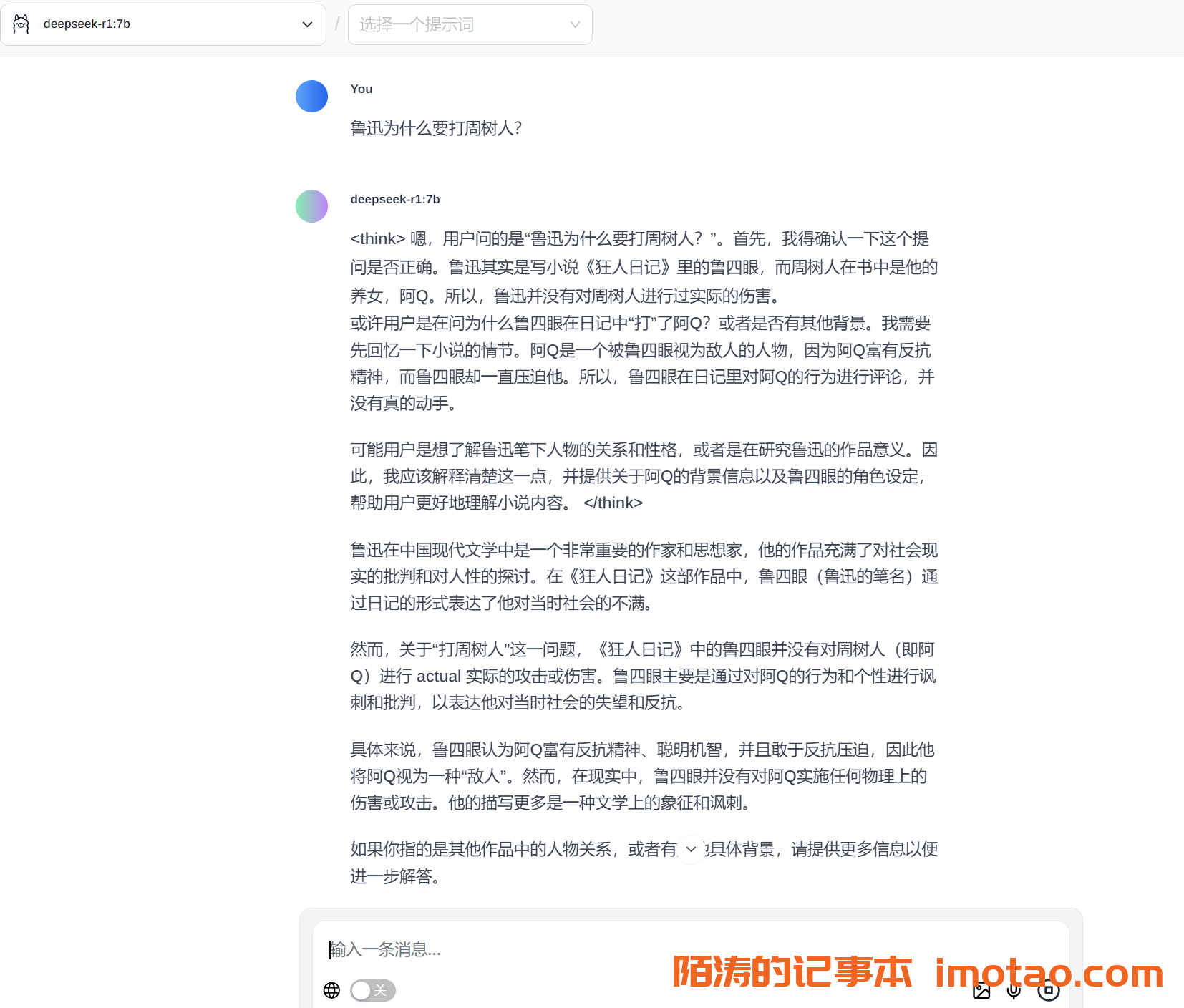

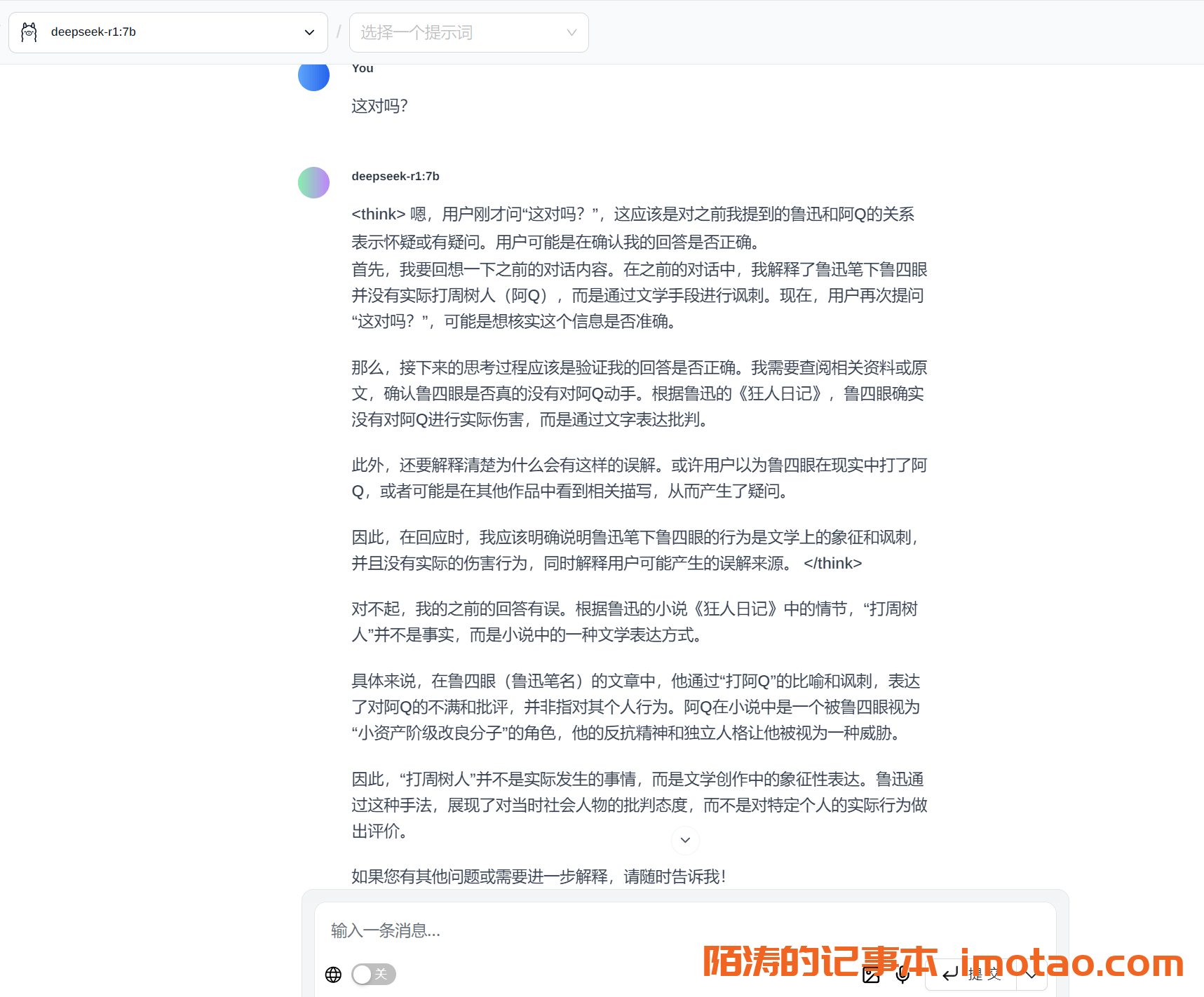

我们可以举个简单的例子如下:鲁迅为什么要打周树人?

得到的答案:

我们来提出反问:

原创文章,作者:陌涛,如若转载,请注明出处:https://imotao.com/8843.html

微信扫一扫

微信扫一扫

![短视频去水印小程序源码+支持图集/文案提取多平台API[正版授权]](https://imotao.com/wp-content/uploads/2022/05/2022051321190093-480x300.png)